AI technology is booming, with 83% of organizations expecting to increase their investments in generative AI over the next three years. But as companies race to build and deploy intelligent applications, they're running into challenges. Most organizations lack the in-house AI skills needed, leading to new low-code and no-code solutions to simplify the development of AI-powered apps. They’re also struggling to address security, scalability, and performance for this new category of applications, requiring new methods compared to non-AI apps.

A security-first approach to AI

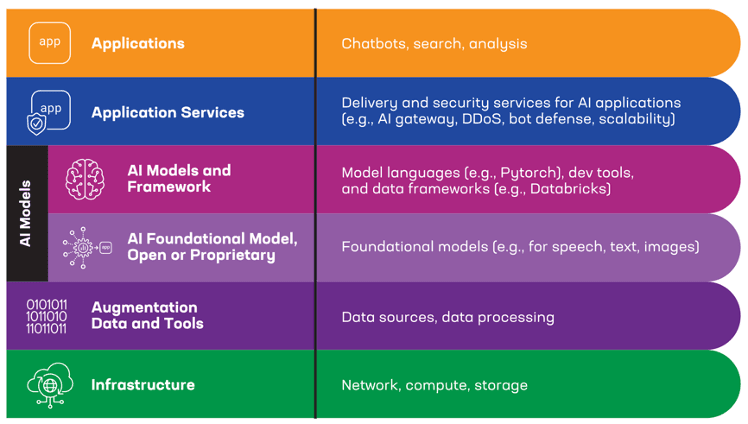

When it comes to AI applications, security can't be an afterthought. With model security ranking as the second highest AI concern after cost, organizations need a security-first approach that protects both their AI models and the applications that leverage them. This means having a security strategy for every layer of the AI infrastructure architecture.

Protect the new AI stack with F5 and Google Cloud.

F5 and Google Cloud work together to provide cloud security for AI that protects the entire application stack. Google Cloud provides secure infrastructure upon which to run your AI models and apps, but as part of the shared responsibility model, you must secure your data and applications.

Our partnership makes it easier to build secure AI-powered apps through a combination of Google Cloud solutions for AI development, dedicated AI security in F5 AI Gateway, and modern app security solutions from F5.

Accelerate AI development with Google Cloud

Google Cloud AI solutions eliminate the traditional barriers to building intelligent applications. Instead of requiring deep machine learning expertise, developers can leverage the Google Cloud Vertex AI platform for end-to-end machine learning (ML) model development and deployment. Pre-trained first- and third-party models serve as a starting point to build or fine-tune from, which can then be deployed and served from Google Kubernetes Engine (GKE). All of this runs on secure, purpose-built AI infrastructure, including cloud Tensor Processing Units (TPUs) that offer high reliability and availability.

Protect against AI-specific threats

AI models and the applications that connect to them are vulnerable to AI-specific threats that attempt to poison the AI model or manipulate outputs. F5 AI Gateway works alongside Google Cloud AI solutions to block inbound attacks, such as prompt injection, and monitor inputs to detect accidental exposure of personally identifiable information (PII).

While AI models and apps need AI-specific protections, they also need defenses against traditional application threats. APIs are a particular risk due to how numerous they are in AI applications, but bots and distributed denial-of-service (DDoS) attacks are concerns, too. By integrating F5 security solutions such as F5 Distributed Cloud Web App and API Protection with Google Cloud, organizations can protect against OWASP Top 10 threats for applications.

Optimize the AI experience

Modern AI applications need to deliver consistent performance wherever users are located without wasting expensive compute resources. Google Cloud's global infrastructure creates an efficient foundation for AI deployment, with distributed edge locations that minimize latency for users worldwide. Increased performance with intelligent traffic management from F5 AI Gateway ensures optimal resource utilization and seamless scaling to match demand, including routing between multiple large language models (LLMs).

Flexible security and optimization where you need it

AI Gateway is Kubernetes-based, meaning it can run in GKE, other public clouds, private clouds, and on-premises data centers for AI application protection and performance anywhere. View AI Gateway logs in Google Cloud to streamline visibility or export OpenTelemetry data to your security information and event management (SIEM) or security orchestration, automation and response (SOAR) application to collect metrics on AI security and performance.

Google Cloud and F5 provide the development tools, infrastructure, and security necessary to turn AI aspirations into reality—without compromising on protection or performance. These solutions address real-world concerns about data privacy, model security, and operational efficiency to help organizations move faster while maintaining the controls they need to run with confidence.

To learn more, see our F5 on Google Cloud Platform webpage.

About the Author

Related Blog Posts

F5 joins the Dell AI Ecosystem Program to help enterprises operationalize AI

F5 joins the Dell AI Ecosystem Program to help enterprises deploy production AI with greater performance, security, and control.

Why sub-optimal application delivery architecture costs more than you think

Discover the hidden performance, security, and operational costs of sub‑optimal application delivery—and how modern architectures address them.

Keyfactor + F5: Integrating digital trust in the F5 platform

By integrating digital trust solutions into F5 ADSP, Keyfactor and F5 redefine how organizations protect and deliver digital services at enterprise scale.

Architecting for AI: Secure, scalable, multicloud

Operationalize AI-era multicloud with F5 and Equinix. Explore scalable solutions for secure data flows, uniform policies, and governance across dynamic cloud environments.

AppViewX + F5: Automating and orchestrating app delivery

As an F5 ADSP Select partner, AppViewX works with F5 to deliver a centralized orchestration solution to manage app services across distributed environments.

F5 NGINX Gateway Fabric is a certified solution for Red Hat OpenShift

F5 collaborates with Red Hat to deliver a solution that combines the high-performance app delivery of F5 NGINX with Red Hat OpenShift’s enterprise Kubernetes capabilities.