Organizations worldwide are building generative AI applications at a dizzying pace. These homegrown applications have become essential to driving innovation and new efficiencies. But even some of the most transformational generative AI applications could risk exposing the organization to brand-new attack surfaces.

Successful attacks such as prompt injections, jailbreaks, or remote code execution could lead to security breaches and data leaks. Similarly, potentially harmful or toxic responses by large language models (LLMs) to an organization’s stakeholders could bring reputational damage, legal issues, and monetary losses.

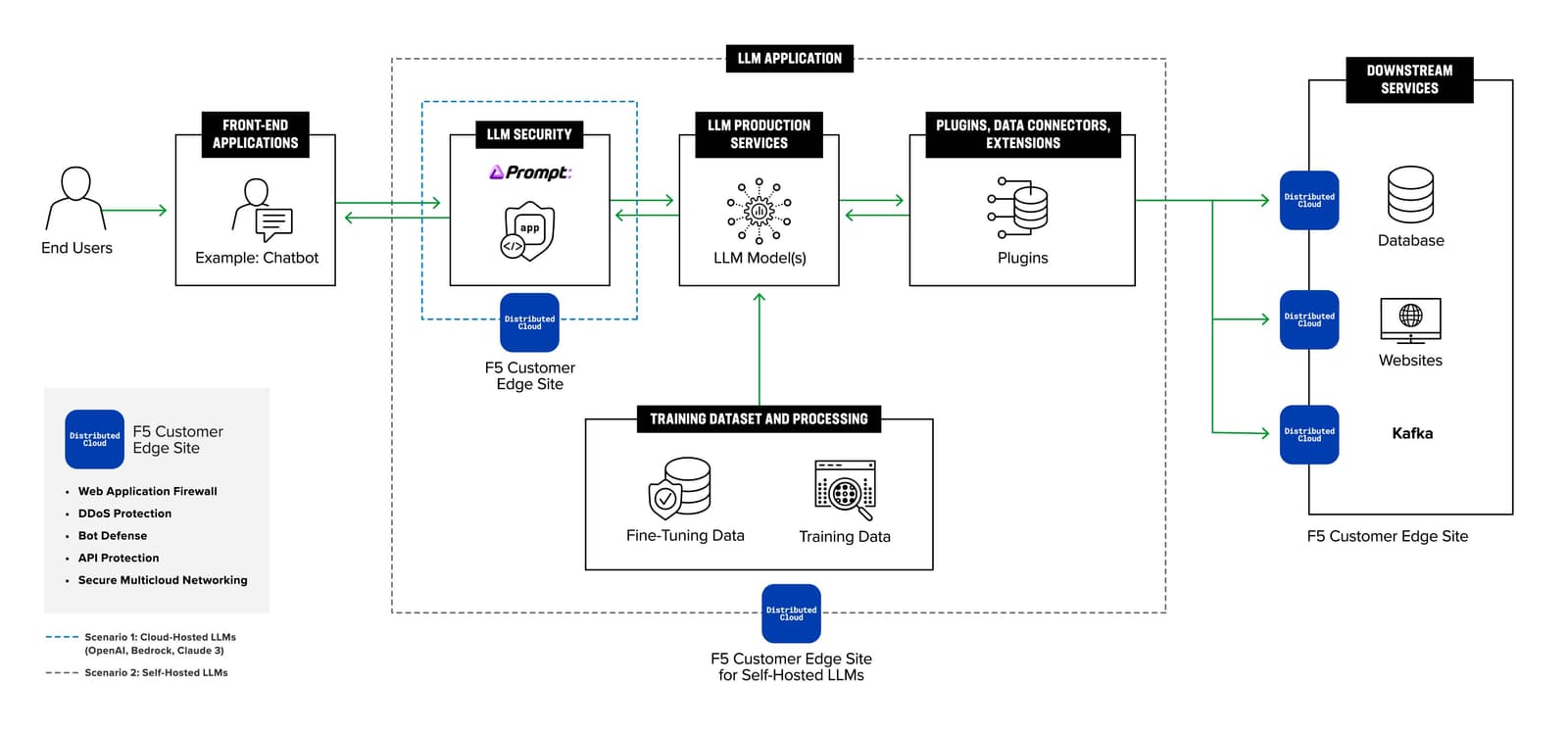

In response to the growing need to protect applications powered by generative AI, the F5 Distributed Cloud Platform is expanding its third-party technology partnerships to include technologies that secure generative AI applications. Prompt Security, an AI firewall, is now supported by F5 Distributed Cloud App Stack. The Distributed Cloud Platform provides application security such as WAF, bot defense, DDoS protection, and API discovery/security, and removes complexity of networking with Customer Edge. This partnership showcases the extensibility of F5 Distributed Cloud Services and makes it easy for customers to secure AI applications across on-prem, edge, hybrid, and multicloud environments. The Prompt Security firewall for AI protects inbound generative AI queries and outbound responses, making sure organizations are safeguarded from prompt injections, sensitive data disclosure, harmful responses, and other hacks.

Key principles of securing generative AI applications

1. Addressing generative AI-specific security risk

Generative AI applications are bringing a brand-new setup of security risks. As a result, traditional security approaches alone won’t suffice. Prompt Security inspects every prompt and model response to protect against a range of new threats such as prompt injections, jailbreaking, denial of wallet, and more. All traffic to generative AI applications is routed through Prompt Security, providing complete visibility on incoming prompts.

2. Moderating content produced by LLMs

Equally as important as inspecting user prompts before they get to an organization’s systems is ensuring that responses by LLMs are safe and do not contain toxic or harmful content that could be damaging to an organization.

3. Ensuring data privacy and preventing leaks

In developing operational generative AI applications, the applications will have access to databases and resources of an organization (or third party) to provide the most beneficial user experience. However, without proper security measures, organizational data can be disclosed as part of the responses generated by LLMs. This could potentially enable a user to deceive the application into revealing confidential information, leading to possible legal and reputational consequences.

4. Implementing governance and visibility

App developers and security teams monitor inbound and outbound traffic from generative AI apps at all possible insertion points. This will become more significant as an organization’s governance and regulations surrounding AI grow in detail and are more strongly enforced. Prompt Security provides full logging on each generative AI interaction. The logging includes user, prompt, response, findings, and more.

Drive business productivity with secure Gen AI applications

Prompt Security firewall for AI enables F5 Distributed Cloud Services customers to protect their generative AI applications at every touchpoint. With built-in immediate observability and policy management, organizations can secure their generative AI applications, improve business productivity, and maintain data governance.

To read Prompt Security’s press release, please visit here.

To see a demo of Prompt Security + F5 Distributed Cloud Services in action, please view https://www.youtube.com/watch?v=rP4fgpXgv3Q.

To better understand how F5 Distributed Cloud Services can help organizations build infrastructure for any application anywhere, please visit https://www.f5.com/cloud.

To learn more about how Prompt Security, please visit https://www.prompt.security.

About the Author

Related Blog Posts

F5 joins the Dell AI Ecosystem Program to help enterprises operationalize AI

F5 joins the Dell AI Ecosystem Program to help enterprises deploy production AI with greater performance, security, and control.

Why sub-optimal application delivery architecture costs more than you think

Discover the hidden performance, security, and operational costs of sub‑optimal application delivery—and how modern architectures address them.

Keyfactor + F5: Integrating digital trust in the F5 platform

By integrating digital trust solutions into F5 ADSP, Keyfactor and F5 redefine how organizations protect and deliver digital services at enterprise scale.

Architecting for AI: Secure, scalable, multicloud

Operationalize AI-era multicloud with F5 and Equinix. Explore scalable solutions for secure data flows, uniform policies, and governance across dynamic cloud environments.

AppViewX + F5: Automating and orchestrating app delivery

As an F5 ADSP Select partner, AppViewX works with F5 to deliver a centralized orchestration solution to manage app services across distributed environments.

F5 NGINX Gateway Fabric is a certified solution for Red Hat OpenShift

F5 collaborates with Red Hat to deliver a solution that combines the high-performance app delivery of F5 NGINX with Red Hat OpenShift’s enterprise Kubernetes capabilities.